QNM

News

Sport

Motori

Nuova frecciata di Belen Rodriguez: ci va giù pesante, la storia non lascia spazio a dubbi

Sui social Belen Rodriguez lancia una pungente frecciatina che non sembra lasciare alcun dubbio, ecco …

Carlo Conti, nuovo programma dopo “Tale e Quale”: cosa andrà a condurre

Carlo Conti dopo la fine di Tale e Quale show, tornerà in onda con un …

Terra Amara, anticipazioni inquietanti dalla Turchia: prima un rapimento e poi una sparatoria

Nuove clamorose anticipazioni giungono dalla Turchia: Umit mostra ancora una volta tutta la sua follia …

“Sosia di Sabrina Ferilli”: chi è la donna che sta diventando sempre più famosa in tv

Avete mai visto la sosia di Sabrina Ferilli: lei sta diventando davvero molto famosa in …

Economia

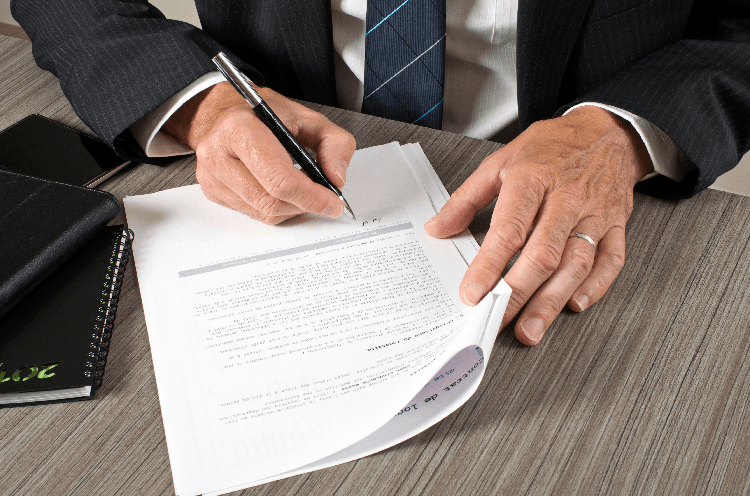

La polizza fideiussoria: cosa è e come funziona

Uno degli strumenti contrattuali più frequentemente usati nel mondo degli affari e nei rapporti commerciali …

Stufa a pellet e termosifoni: con questo metodo il portafoglio non si svuota

Per risparmiare sui costi del riscaldamento, c’è solo una cosa che devi fare: collegare insieme …